Xiaomi разработала ИИ‑модель с 4,7 млрд параметров, сочетающую визуальное восприятие, речь и управление для роботов.

Xiaomi выходит на рынок робототехники

Китайский гигант мобильных устройств и умного дома, известный как Xiaomi, объявил о новом шаге: разработке собственной модели искусственного интеллекта для роботов. Компания представила Xiaomi‑Robotics‑0, систему с открытым исходным кодом, объединяющую визуальное распознавание, понимание языка и контроль действий в реальном времени. Модель насчитывает 4,7 млрд параметров и уже установила несколько рекордов как в симуляциях, так и на практике.

Как работает модель

Робот обычно проходит цикл «восприятие → решение → действие». Xiaomi‑Robotics‑0 балансирует между широким пониманием ситуации и точным управлением моторикой благодаря архитектуре Mixture‑of‑Transformers (MoT).

1. Визуально‑языковая модель (VLM) – «мозг» системы.

* Обучена интерпретировать команды, даже размытые (“пожалуйста, сложи полотенце”).

* Понимает пространственные отношения на основе высококачественных изображений.

* Задачи: обнаружение объектов, ответы на визуальные вопросы и логическое рассуждение.

2. Эксперт по действиям (Action Expert) – генератор движений.

* Основан на диффузионном трансформере (DiT).

* Не генерирует одно действие за раз; формирует последовательность действий через сопоставление потоков, что обеспечивает плавность и точность.

Обучение без потери понимания

Обычные VLM теряют часть своих навыков восприятия при обучении физическим задачам. Xiaomi решила эту проблему, одновременно обучая модель мультимодальным данным (изображения + текст) и данными о действиях. Процесс обучения состоит из нескольких этапов:

1. Предложение действий – VLM предсказывает возможные распределения действий по изображениям, синхронизируя внутреннее представление с реальными операциями.

2. После этого VLM «выключается», и DiT проходит отдельное обучение генерации точных последовательностей из шума, опираясь на ключевые признаки, а не на токены языка.

Минимизация задержек

Для устранения пауз между прогнозами модели и реальными движениями робота использована асинхронная выдача: вычисления ИИ и действия робота разделены. Это позволяет роботам двигаться непрерывно даже при необходимости дополнительного расчёта.

* Clean Action Prefix – метод возврата ранее предсказанного действия, обеспечивающий плавность без рывков.

* Маска внимания фокусируется на текущем визуальном ряду, игнорируя прошлые состояния, что делает робота более отзывчивым к внезапным изменениям окружения.

Результаты

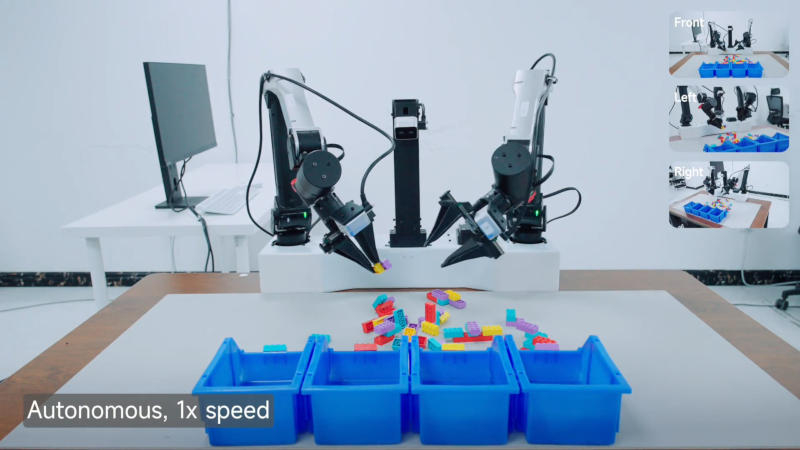

В симуляционных средах LIBERO, CALVIN и SimplerEnv Xiaomi‑Robotics‑0 превзошёл около 30 конкурентов. На реальном роботе с двумя манипуляторами модель успешно справилась со сложными задачами: складывание полотенец, разборка конструктора. Робот демонстрировал устойчивую координацию рук и глаз, одинаково эффективно манипулируя объектами в различных сценариях.

Таким образом, Xiaomi не только расширила свой портфель продуктов, но и заложила фундамент для дальнейших исследований в области «физического интеллекта» роботов.

Asted Cloud

Asted Cloud

Комментарии (0)

Оставьте отзыв — пожалуйста, будьте вежливы и по теме.

Войти, чтобы комментировать