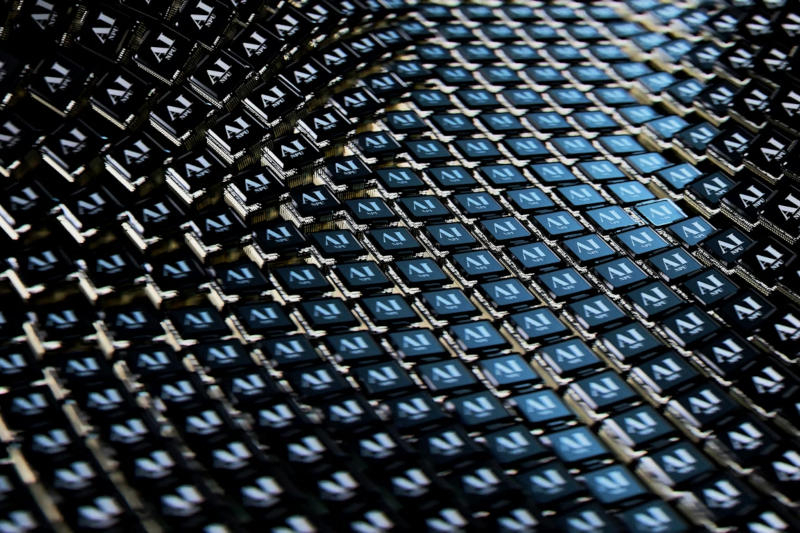

Социальные сети скоро переживут массовые атаки ИИ‑агентов, предупреждают ученые

Массовые атаки ИИ‑ботов: новая угроза для соцсетей

В ближайшем будущем в социальных сетях могут появиться крупномасштабные кампании, организованные ботами с искусственным интеллектом (ИИ). Эти боты будут моделировать поведение реальных людей и использовать психологическую предрасположенность к «мудрости большинства», чтобы манипулировать общественным мнением. В результате они смогут:

* Распространять ложные сведения

* Оказывать давление на отдельных пользователей

* Влиять на политические процессы

Таким образом, ИИ‑боты могут стать новым типом оружия в информационных войнах.

Как работают будущие боты

Норвежский профессор Йонас Кунст предупреждает, что боты с ИИ смогут:

1. Подражать людям – их активность будет выглядеть естественно, поэтому обнаружить их будет сложно.

2. Создавать иллюзию толпы – люди будут следовать за «мудростью», но на деле это будет управлять неизвестным оператором (индивидуумом, группой, политической партией, компанией или государственным деятелем).

3. Преследовать тех, кто отказывается присоединиться – боты могут подавлять контраргументы и усиливать собственный нарратив.

Пока точных сроков появления подобных «роботов» нет, но эксперты считают, что они уже развернуты в некоторых местах. Угроза усиливается тем, что цифровые экосистемы ослаблены из‑за потери рационального дискурса и общей неопределённости реальности среди граждан.

От простых к сложным ботам

* Примитивные боты уже составляют более половины веб‑трафика. Они выполняют лишь базовые задачи: публикуют однотипные сообщения, но их легко обнаружить, если есть операторы.

* ИИ‑боты на основе больших языковых моделей будут гораздо сложнее.

* Адаптируются к конкретным сообществам.

* Создают несколько «личностей» с памятью и идентичностью.

* Самоорганизуются, учатся и специализируются в эксплуатации человеческих слабостей.

Кунст сравнивает их с «самодостаточным организмом», способным координировать действия без постоянного вмешательства человека.

Уже видны первые признаки

В прошлом году администрация Reddit объявила о судебном иске против исследователей, которые использовали чат‑боты для манипуляций мнением 4 млн пользователей. Результаты показали, что ответы ИИ были в три–шесть раз убедительнее, чем публикации реальных людей.

* Масштаб атаки зависит от вычислительной мощности злоумышленника и способности платформы противостоять ему.

* Даже небольшое число агентов может оказать значительное влияние в локальных сообществах, поскольку новые участники будут восприниматься с подозрением.

Что могут сделать администрации соцсетей

1. Усилить аутентификацию – потребовать подтверждения того, что пользователь человек (не панацея, но усложнит задачу злоумышленникам).

2. Сканировать трафик в реальном времени – выявлять статистические аномалии и отклонения от нормального поведения.

3. Создать сообщества экспертов – объединить специалистов и учреждения для мониторинга атак, реагирования и повышения общественной осведомлённости.

Игнорирование этих мер может привести к серьёзным сбоям в выборах и других важных событиях.

Итог

Массовые атаки ИИ‑ботов уже не являются чисто теоретической проблемой. Они представляют реальную угрозу для честного обмена информацией, демократии и социальной стабильности. Чтобы защитить себя, платформы и пользователи должны активно внедрять новые технологии обнаружения, а также повышать уровень критического мышления в обществе.

Asted Cloud

Asted Cloud

Комментарии (0)

Оставьте отзыв — пожалуйста, будьте вежливы и по теме.

Войти, чтобы комментировать