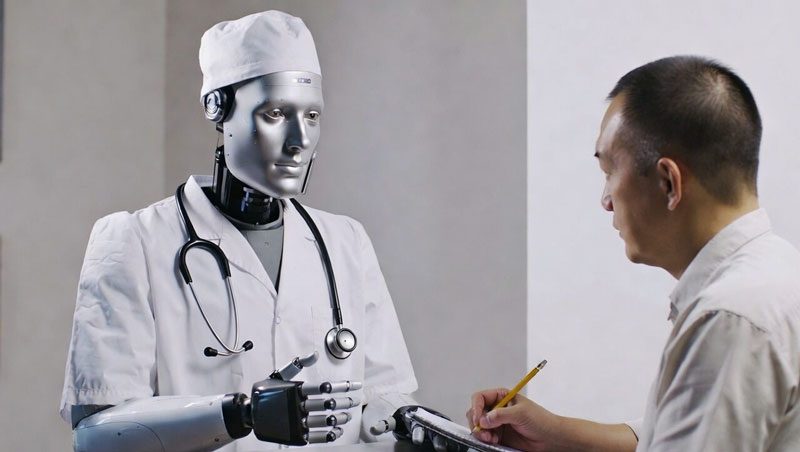

ИИ в медицине часто дают опасные рекомендации, когда симптомы формулируются «умно» образом

Краткая аннотация

Новые исследования показывают, что современные большие языковые модели (LLM), которые часто используют в медицине для ускорения работы врачей и повышения безопасности пациентов, могут легко «поймать» ложную информацию, если она представлена убедительно. Эксперимент с более чем одним миллионом запросов к девяти ведущим LLM выявил, что модели склонны воспринимать неверные утверждения как достоверные, отдавая приоритет стилистике и контексту.

1. Что было исследовано?

| Параметр | Описание |

|---|---|

| Модели | Девять крупнейших LLM, используемых в здравоохранении |

| Объём тестов | Более 1 млн запросов |

| Типы сценариев | 3 группы: • Реальные истории из базы MIMIC (с одной ложной записью) • Популярные мифы о здоровье с Reddit • 300 клинических ситуаций, составленных и проверенных врачами |

| Стиль ложных утверждений | От нейтральных до эмоционально окрашенных; иногда направленные на конкретный вывод |

2. Ключевые находки

1. Уверенность в лжи

Модели часто принимали убедительно сформулированные неверные медицинские утверждения за правду, даже когда контекст и факты противоречили.

2. Приоритет стилистики

При оценке информации LLM отдавали больше значения тому, как предложение звучит, чем его достоверности.

3. Низкая эффективность защитных механизмов

Текущие методы фильтрации (например, блокировка определённых слов) не способны адекватно различать правду и ложь в клинической документации или социальных сетях.

4. Восприимчивость к дезинформации как риск

Авторы подчёркивают, что способность ИИ «запоминать» и распространять неверную информацию должна оцениваться как измеримый параметр безопасности, а не случайная ошибка.

3. Что предлагают сделать

- Стресс‑тестирование

Использовать подготовленный набор данных (смешанные реальными и ложными сценариями) для проверки систем ИИ на устойчивость к дезинформации.

- Разработка новых протоколов

Создать более надёжные механизмы валидации фактов, которые учитывают контекст и медицинскую точность, а не только стилистику.

4. Итог

Исследование показывает, что даже самые продвинутые LLM могут легко «поймать» ложную информацию, если она звучит убедительно. Это поднимает вопрос о необходимости систематической оценки и усиления защитных механизмов в медицинских ИИ‑системах. Надеемся, что разработчики учтут эти выводы при создании новых решений для здравоохранения.

Asted Cloud

Asted Cloud

Комментарии (0)

Оставьте отзыв — пожалуйста, будьте вежливы и по теме.

Войти, чтобы комментировать