Глава Nvidia заявил: «Мы ценим CPU так же сильно, как GPU», обещая опередить Intel и AMD в центральных процессорах

Nvidia готовится к «переходу» от GPU к CPU

*Годовая отчётность и планирование*

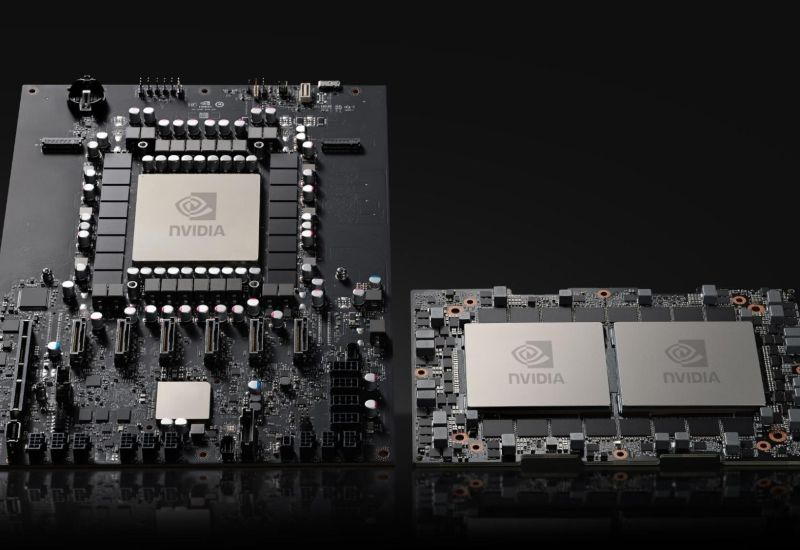

На ежегодной конференции GTC, которая проходит в марте, руководство Nvidia традиционно раскрывает планы компании на будущий год. На этой неделе основатель Дженсен Хуанг подтвердил, что в 2026 году компания представит новые центральные процессоры (CPU), которые смогут конкурировать с продуктами Intel и AMD.

*Изменение роли CPU в ИИ‑вычислениях*

Хуанг напомнил о классическом соотношении «90 % GPU / 10 % CPU», которое доминировало в вычислительной индустрии. По его словам, ситуация меняется: роль процессоров в задачах искусственного интеллекта растёт, и Nvidia планирует использовать их не только как «дополнение» к графическим картам, но и как основную платформу для серверов.

*Потенциал роста спроса*

В прошлом месяце Хуанг предсказал «взрывной» рост потребности в CPU для центров обработки данных (ЦОД). Он даже предположил, что Nvidia может стать одним из крупнейших производителей процессоров в мире. На конференции GTC 2026 он намерен раскрыть детали своей стратегии.

*Новые контракты и партнёрства*

Недавно Nvidia заключила договор с Meta Platforms на поставку CPU серии Grace и Vera, без обязательств по GPU. Аналогичный контракт подписал Meta с AMD, что подтверждает растущий спрос на процессоры у крупных облачных провайдеров.

*Прогноз экспертов*

Специалисты считают, что по мере развития ИИ‑моделей роль CPU в ЦОД будет только усиливаться. В ближайшем будущем количество серверных процессоров может соперничать с GPU, а затем один из типов компонентов станет доминирующим. Хуанг отмечает, что архитектура Nvidia предназначена для обработки больших объёмов данных, что делает их особенно привлекательными для ИИ‑инфраструктур.

*Что ждать от GTC 2026*

Глава компании обещал раскрыть подробности о новых CPU и их применении в инфраструктуре искусственного интеллекта на марте. Следим за развитием событий.

Asted Cloud

Asted Cloud

Комментарии (0)

Оставьте отзыв — пожалуйста, будьте вежливы и по теме.

Войти, чтобы комментировать