Будущее «ChatGPT‑момент» для человекоподобных роботов отложено на ближайшие десять лет

Кратко о ситуации в отрасли человекоподобной робототехники

| Что обсуждают | Кто говорит | Ключевые идеи |

|---|---|---|

| Время появления прорыва | Ван Сяоган (Daxiao Robotics), Дженсен Хуанг (Nvidia) | Прорыв возможен уже через 2‑3 года благодаря масштабированию данных и симуляциям. |

| Шао Хао (Vivo) | Ожидается около десятилетия, пока не появятся дешёвые, разнообразные реальные данные. | |

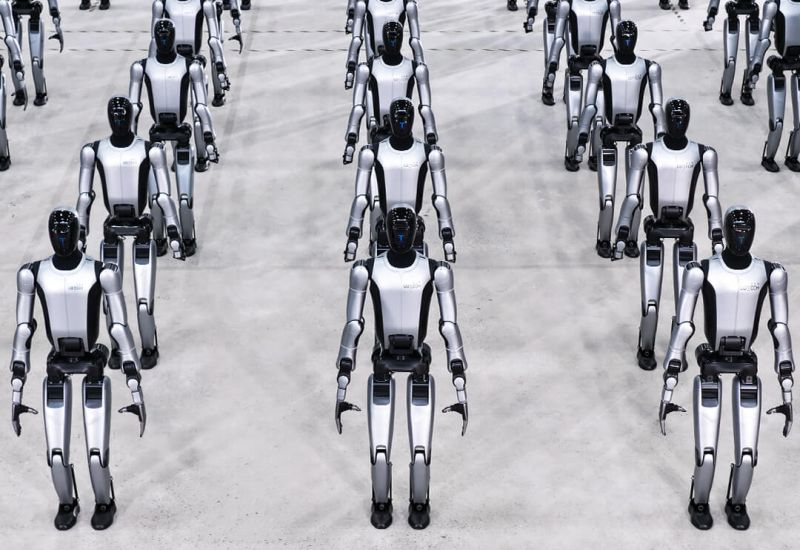

| Текущее состояние | Китайские разработчики | Демонстрация хореографии и акробатики на новогоднем концерте, но движения «запрограммированы» и выполняются в контролируемой среде. |

| Проблемы, которые остаются | Все участники рынка | 1) Ограниченный доступ к большим объёмам дешёвых данных; 2) Стабильность и надёжность кинетических систем; 3) Доверие общественности. |

| Этические и социальные вопросы | Дженни Шипли (бывшая премьер‑Новой Зеландии) | Люди не должны ожидать эмоциональных суждений от роботов. Необходимо регулировать их функции, обеспечивать безопасность данных и управлять ответственностью. |

Что происходит сейчас

1. Воздействие ChatGPT

Открытие модели в 2022 году изменило IT‑рынок и глобальную экономику. Это событие стало «пульсом» для дальнейшего развития ИИ.

2. Прогнозы по человекоподобным роботам

- *Ван Сяоган* утверждает, что через пару лет можно достичь значительного прогресса, если увеличить объём данных и использовать симуляции мировых моделей.

- *Дженсен Хуанг* поддерживает идею цифровых двойников как инструмента ускорения обучения.

- *Шао Хао* считает, что полноценный прорыв потребует около десяти лет из‑за нехватки реальных данных.

3. Показатели в 2024 году

Китайские роботы продемонстрировали акробатические и боевые навыки на национальном концерте. Однако движения были «запрограммированы» по шаблонам живых хореографов, а тесты проводились в статичных условиях.

Ключевые барьеры

| Барьер | Почему это важно |

|---|---|

| Недостаток дешевых данных | Без большого объёма реальных наблюдений роботы не могут адаптироваться к бытовой среде. |

| Надёжность движений | Стабильность и безопасность критичны для взаимодействия с людьми. |

| Общественное доверие | Люди опасаются, что роботы будут принимать эмоциональные решения; требуется прозрачная регуляция. |

Как подготовиться к массовому внедрению

1. Стандарты безопасности – разработать нормы эксплуатации и обслуживания.

2. Социальные политики – обеспечить достойное применение освобождающихся человеческих ресурсов.

3. Защита данных – сбора визуальной и аудио информации не должно угрожать кибербезопасности.

Регуляторный пример

Сингапур уже предложил рамочные правила для ИИ‑агентов, которые могут служить моделью для робототехники. Дженни Шипли подчёркивает важность ясной структуры управления и распределения ответственности: «Я не знаю, кто сейчас за рулём». Это подчёркивает необходимость прозрачности в управлении и регулировании новых технологий.

Итог:

Выход ChatGPT подтвердил огромный потенциал ИИ. В области человекоподобных роботов прогнозы разделились – от 2 до 10 лет до реального прорыва. На данный момент демонстрации впечатляют, но для практического применения нужны масштабные данные, надёжность движений и общественное доверие, которые можно обеспечить только через стандарты безопасности и прозрачное регулирование.

Asted Cloud

Asted Cloud

Комментарии (0)

Оставьте отзыв — пожалуйста, будьте вежливы и по теме.

Войти, чтобы комментировать